DeepSeek再发新论文,DualPath架构如何将推理吞吐量提升近2倍?

扫一扫

分享文章到微信

扫一扫

关注豌豆财经网微信公众号

2月27日消息,就在外界翘首期盼DeepSeek-V4大模型发布之际,DeepSeek团队再次带来了一份技术惊喜。

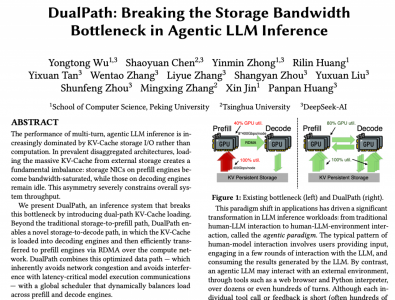

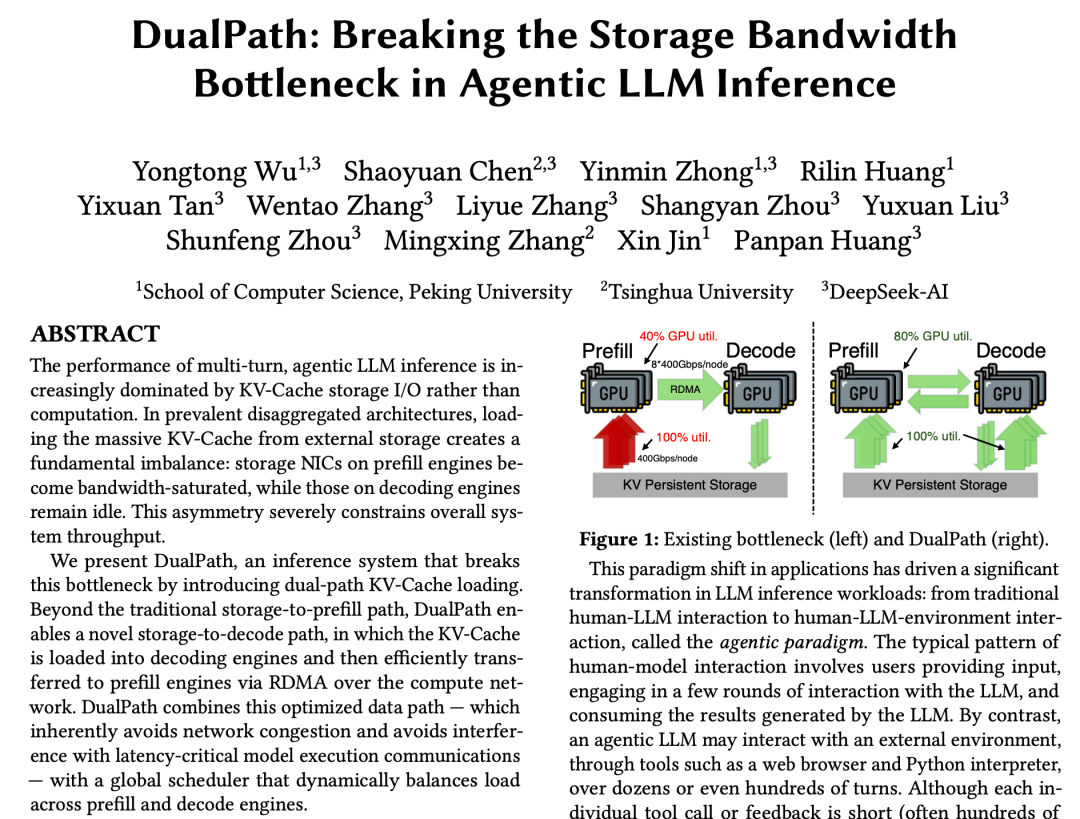

DeepSeek联合北京大学、清华大学发布了一篇题为《DualPath: Breaking the Storage Bandwidth Bottleneck in Agentic LLM Inference》的论文,提出了一种创新的推理系统架构,直指当前大语言模型在多轮Agent交互场景下的核心性能瓶颈。

论文开篇指出了一个重要趋势:LLM正在从单轮对话机器人演变为能够自主规划、调用工具、解决现实世界任务的Agentic系统。在这种新范式下,模型不再处理孤立的提示词,而是参与长达数十甚至数百轮的长期会话,上下文不断累积。

这种变化带来了全新的计算特征:高KV-Cache(键值缓存)命中率、低计算需求。论文中的数据显示,在典型的编码任务轨迹中,平均轮次达到157轮,平均上下文长度32.7K tokens,而每次追加的平均长度仅429 tokens,这意味着KV-Cache命中率高达98.7%。

这种“长上下文、短追加、多轮次”的工作负载模式,使得KV-Cache的加载效率而非计算效率成为主导性能的关键因素。

现有架构的致命弱点

当前主流的LLM推理系统普遍采用预填充-解码分离架构。在这种设计中,预填充引擎负责从分布式存储加载KV-Cache,然后传输给解码引擎进行自回归生成。

然而,论文揭示了一个严重的资源利用不平衡问题:预填充引擎的存储网络带宽成为整个系统的吞吐瓶颈,而解码引擎的存储网络带宽却基本闲置。

更令人担忧的是硬件发展趋势。论文数据显示,从NVIDIA Ampere架构到Blackwell架构,I/O与计算的比例下降了14.4倍。这意味着GPU算力增长远快于网络带宽和HBM容量的增长,导致I/O瓶颈问题日益严重。

DualPath的创新突破

面对这一挑战,DeepSeek团队提出了一个反直觉的解决方案:让KV-Cache加载不再局限于预填充引擎。

DualPath的核心洞察是:可以利用解码引擎闲置的存储带宽来加载KV-Cache,然后通过高性能RDMA计算网络传输给预填充引擎。这种“双路径加载”架构将存储I/O从单一瓶颈资源转变为全局可调度的容量池。

具体实现中,DualPath在预填充引擎和解码引擎上各分配少量DRAM作为缓冲区。当采用传统的预填充读取路径时,KV-Cache从存储加载到预填充引擎缓冲区,然后逐层传输到GPU HBM进行计算,最后传输给解码引擎。而当采用新颖的解码读取路径时,KV-Cache首先加载到解码引擎缓冲区,然后在预填充计算过程中逐层传输给预填充引擎。

实现这一设计面临三个关键挑战:

第一,细粒度数据传输。 层式预填充技术将KV-Cache分割成众多细粒度块,传输这些小块数据需要极低的开销。DualPath通过设计两种块布局(全量块和层块)来优化传输效率。

第二,流量隔离。 额外的KV-Cache传输流量可能与模型执行中的延迟敏感型集体通信产生干扰。DualPath采用CNIC中心化的数据传输方式,所有进出GPU的数据都必须通过GPU配对的计算NIC,并利用InfiniBand的虚拟通道技术实现严格的流量分级。

第三,动态负载均衡。 系统需要在线决策每条请求使用哪条加载路径。DualPath设计了两级调度算法,综合考虑存储NIC队列长度、GPU计算负载和请求特征,实现计算和网络资源的联合平衡。

推理吞吐量提升近2倍

论文在三个模型上进行了全面评估:DeepSeek-V3.2 660B、一个27B的降规模版本以及Qwen2.5-32B。

实验数据令人印象深刻:在离线批处理推理场景(如强化学习训练中的 rollout 阶段)中,DualPath相比基线系统实现了最高1.87倍的吞吐量提升。在在线服务场景中,DualPath在不违反SLO的前提下,平均提升了1.96倍的Agent每秒处理能力。

研究团队还在多达1152块GPU的规模上验证了DualPath的可扩展性。从2个预填充引擎+4个解码引擎扩展到48+96配置时,系统实现了接近线性的加速。在在线服务场景中,44+88配置实现了22倍的吞吐量提升,同时保持相似的延迟特征。

同时,论文也指出了未来工作方向:更自适应、更灵活的并行度和预填充-解码比例配置方法,以及在大规模部署中实现更低的TTFT(Time To First Token)百分位数。

在万众期待DeepSeek-V4之际,这篇论文展示了DeepSeek团队在系统层面的深厚积累。DualPath的创新不仅解决了当前Agentic LLM推理的核心瓶颈,也为未来更大规模、更复杂的多轮交互应用铺平了道路。(宜月)

投稿邮箱:lukejiwang@163.com 详情访问豌豆财经网:http://www.wdyxw.com.cn

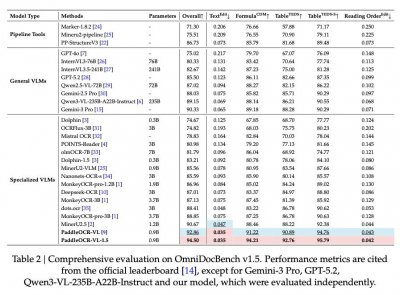

DeepSeek-OCR 2大模型开源,重塑文档AI的认知逻辑

DeepSeek-OCR 2大模型开源,重塑文档AI的认知逻辑

1月27日消息,深度求索(DeepSeek)团队发布了论文《DeepSeek-OCR 2: Visual Causal Flo

互联网2026-01-27

头条资讯

头条资讯